70-80%的用户会忽略付费广告,而将重点放在自然搜索结果上。SEO是将更多流量吸引到您的网站的最便宜,最简单的方法之一。通过针对搜索进行优化,您可以将访问者留在页面。

通过对网站内容进行一些简单的调整,在线搜索的用户将更有可能找到您的主页,这意味着您网站的访问量增加了。Backlinko的一项案例研究显示,由于SEO的努力,有机流量增长了令人难以置信的385%。

根据Search Engine Journal的统计,70-80%的用户会忽略付费广告,而将重点放在自然搜索结果上。SEO是将更多流量吸引到您的网站的最便宜,最简单的方法之一。通过针对搜索进行优化,您可以将访问者留在页面。

搜索引擎分为三个部分:爬网,建立索引和查询。

为了在现有的数亿网页中找到信息,搜索引擎使用了一种特殊的软件机器人,称之为蜘蛛程序,以此生成在网站上查询到的词语列表。蜘蛛程序建立词语列表的过程被称为爬网。为了建立并维护一份有用的词语列表,搜索引擎的蜘蛛程序需要游历大量网页。

蜘蛛程序如何开始其网上旅程?通常起点是那些访问量很大的服务器和热门网页。蜘蛛程序从一个很受欢迎的网站开始,检索网页上的词语并追踪在该网站上找到的每个链接。这样,蜘蛛程序迅速开始了旅行,爬遍网上绝大多数经常访问的网站。

每个蜘蛛程序可以同时打开300个链接。最多可以同时使用四个蜘蛛程序,此时该系统每秒可以游历100多个网页,生成大约600KB的数据。

当Google的蜘蛛程序访问一个HTML网页时,它会记录以下两种信息:

网页中的词语;

词语所在位置。

出现在标题、副标题、元标记以及其他相对重要的位置的词语,会被记录下来,这些词语往往是日后用户搜索时经常使用的。Google蜘蛛程序的设计旨在检索网页中的每一个重要单词(对于英文来说,还要滤掉冠词a、an和the等)。其他蜘蛛程序采用不同的方法。

一旦蜘蛛程序完成了网页信息收集工作(我们应当注意,这是一项永远不可能真正完成的工作——网页不断更新的特性意味着蜘蛛程序需要不断爬网),搜索引擎就必须以一种有效方式存储这些信息。要让收集到的数据可供用户使用,涉及两个关键环节:

以数据存储信息;

为信息建立索引方法。

为了获得更多有用信息,大多数搜索引擎存储的信息不仅仅是词语和网址,还可能存储着该字在网页中出现的次数。搜索引擎可能会为每个词条指定一个权重,按照词语出现在文档开头、网页副标题、链接、元标记或标题的顺序,权重依次增大。

索引的唯一目的是尽快找到信息。通过索引进行搜索需要用户进行一次查询,并通过搜索引擎提交。查询可以相当简单,最少仅需一个词。建立比较复杂的查询则需要使用布尔运算符来细化和拓展搜索项。”

关于SEO的最重要的了解是您的内容必须是高质量的,信息丰富的并且对用户满意。

如果Google足够信任您的页面,可以为您提供最佳的查询结果,那么该页面可以更好地为查看者提供大量的内容。如果很大比例的用户离开您的页面而没有点击到另一个页面,从而导致跳出率很高,则Google会因此而对您不利。

提供越多单词,更精准的信息,页面更长,及时更新等,都可以提高网页的信任度,让Google排序靠前。

质量,长度,看上去都是很重要的影响因素。关键字其实也很重要。Google的算法是一个程序,它分析其索引的每个网页的一系列独特特征。这有助于Google响应用户的查询提供最相关的页面。

Google的关键字规划师是SEO专业人员的最佳工具,它可以帮助您了解如何编写相关内容并必然获得自然搜索流量。简而言之,您可以使用关键字计划器来发现哪些搜索字词在您的利基市场中很流行。

来源:SEO专家Jack

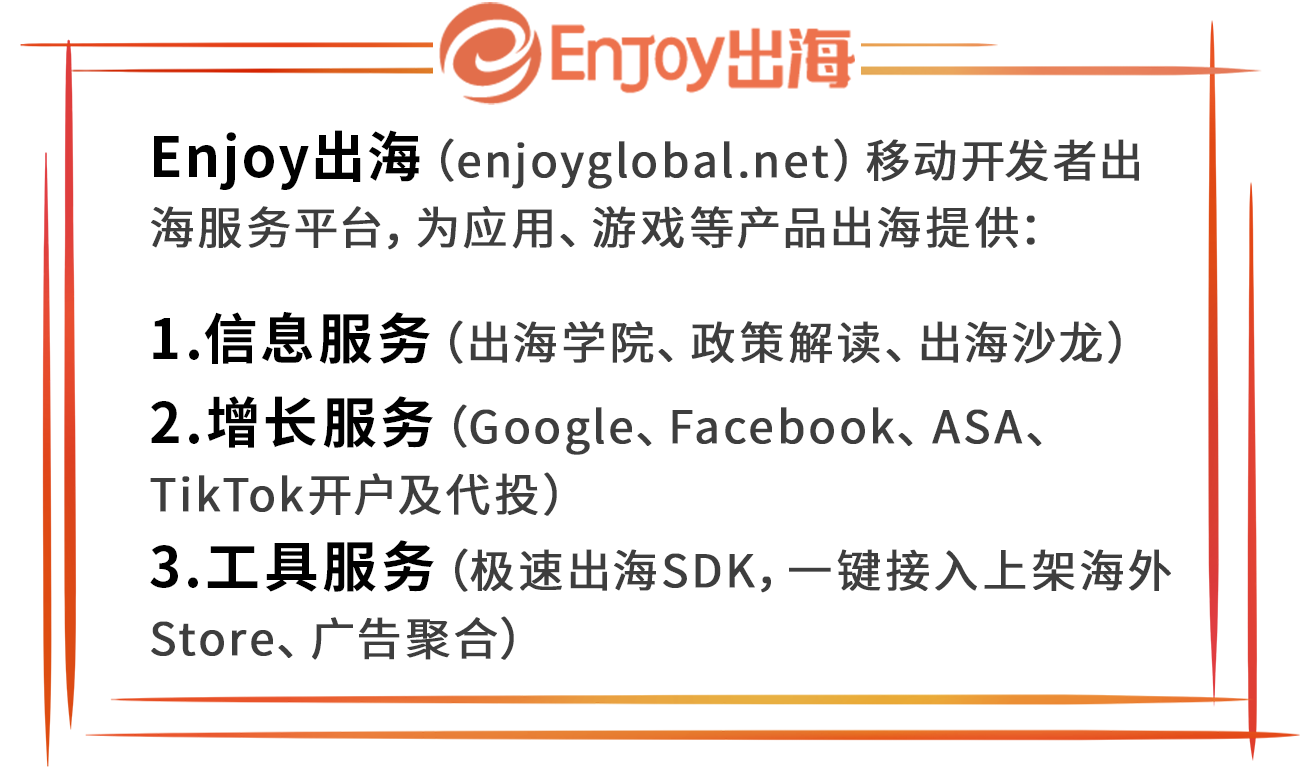

进群了解更多最新出海资讯、市场活动及合作,扫描关注下方二维码吧!

扫一扫 加入出海交流群

个人中心

个人中心 Enjoy后台

Enjoy后台 登出

登出